Расскажу самые базовые вещи о рендере в Adobe After Effects. Будет как небольшая подсказка для новичков.

Рендерить можно двумя способами. Через Render Queue внутри After Effects и через стороннюю программу Adobe Media Encoder.

Для слабых компьютеров или тяжёлых проектов советую Render Queue. А для всего остального — Media Encoder.

Две заметки перед началом

1) Если АЕ 2017 года или ниже — скачайте кодеки Quicktime. На macOS не нужно.

2) Если рендерите через Media Encoder проверьте, чтобы он был того же года, что и After Effects.

К настройкам рендера

Рендерим видео с оптимальным соотношением веса и качества через Media Encoder

Сейчас самый распространённый стандарт сжатия видео — H.264. Мало весит, не убивает качество и везде поддерживается.

— Открываем композицию, которую хотим отрендерить.

— Заходим в Composition → Add to Adobe Media Encoder Queue. Немного ждём, открывается Media Encoder.

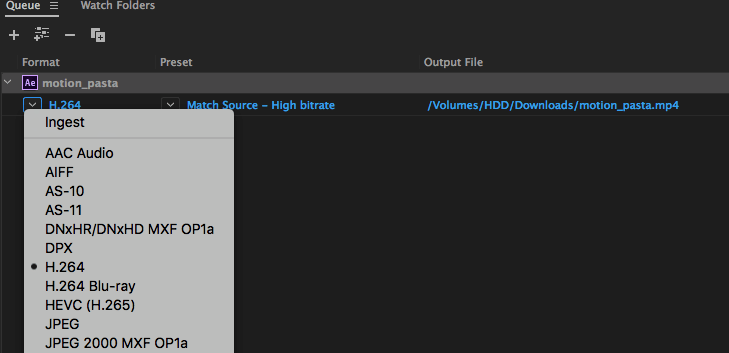

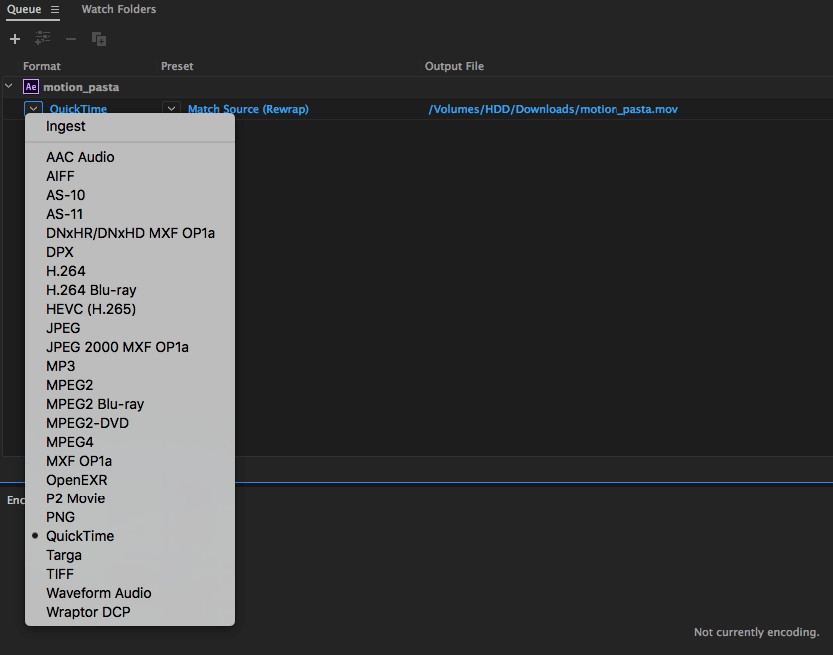

— Нажимаем на стрелочку в Format и выбираем H.264.

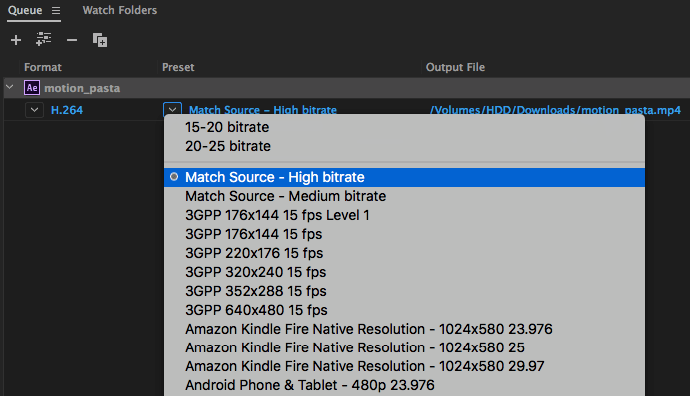

— В Preset выбираем Match Source High Bitrate.

— Output File выбираем куда сохранить. Нажимаем Enter или на зелёный треугольничек справа. Рендер пошёл.

В итоге, минутное видео больше не будет весит несколько гигабайт, а останется где-то в пределах сотни мегабайт.

Рендерим видео с оптимальным соотношением веса и качества через Render Queue

— Открываем композицию, которую хотим отрендерить.

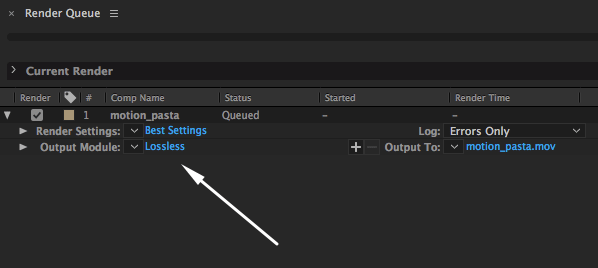

— Заходим в Composition → Add to Render Queue.

— Нажимаем на синий текст рядом с Output Module.

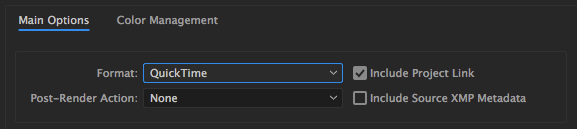

— В Format выбираем Quicktime.

— Нажимаем Format Options.

— В Video Codec выбираем H.264.

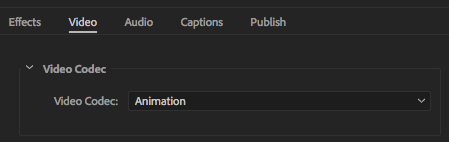

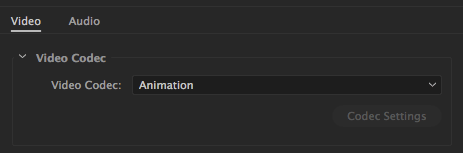

Если АЕ 2018 или старше, то H.264 в списке не будет. Выбирайте Animation.

Файл получится тяжеловатый, но легче, чем совсем без сжатия. Поэтому для последних версий АЕ лучше использовать Media Encoder, где есть H.264.

— Кликаем ОК в двух окошках.

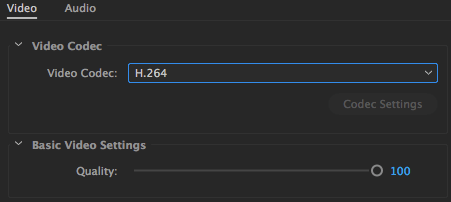

— Справа от Output To нажимаем на синий текст и выбираем куда сохранить.

— Нажимаем Enter или кнопку «Render» справа.

Готово! Рендер начался.

Рендерим видео на альфа-канале через Media Encoder

А сейчас рассмотрим как отрендерить анимацию с прозрачным фоном. Это уже чуть-чуть посложнее.

— Открываем нужную композицию.

— Composition → Add To Adobe Media Encoder Queue

— В Format выбираем Quicktime

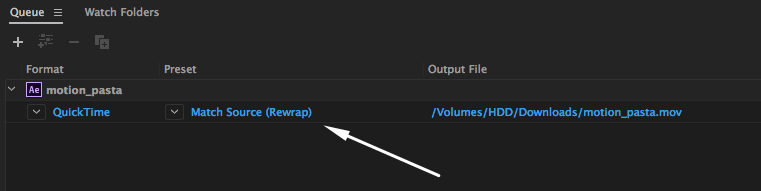

— В Preset ничего не выбираем, просто нажимаем на синий текст

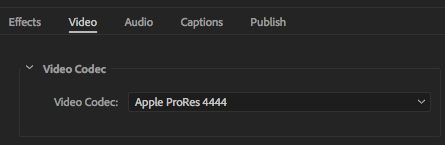

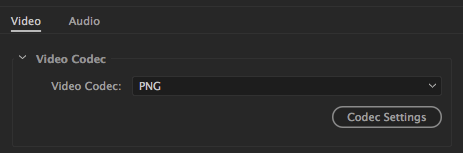

— Теперь выбираем Video Codec в зависимости от версии AE:

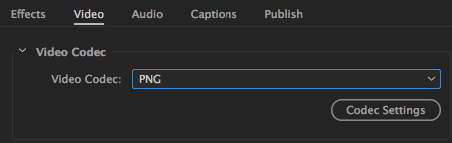

AE 2017 и ниже — PNG.

АЕ 2018 — Animation.

AE 2019 или любая версия на macOS — ProRes 4444.

— Нажимаем кнопку Match Source.

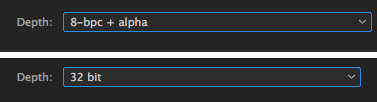

— Проматываем чуть-чуть вниз, в Depth выбираем параметр у которого написано +alpha или 32 bit.

— Нажимаем ОК, в Output выбираем место куда сохранится файл и запускаем рендер.

Всё, теперь ролик отрендерится с прозрачностью, будет потяжелее. Зато на фон можно подставить всё, что угодно.

Рендерим видео на альфа-канале через Render Queue

— Открываем нужную композицию.

— Composition → Add To Adobe Media Encoder Queue

— Кликаем на синий текст рядом с Output Module.

— В Format выбираем Quicktime.

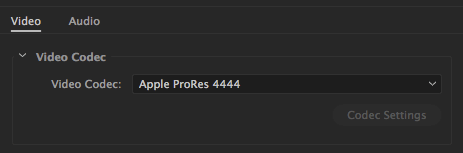

— Нажимаем «Format Options».

— Теперь выбираем Video Codec в зависимости от версии AE:

AE 2017 и ниже — PNG.

АЕ 2018 — Animation.

AE 2019 или любая версия на macOS — ProRes 4444.

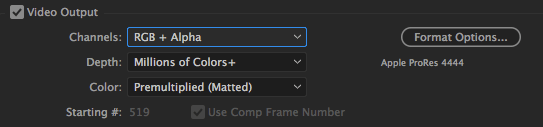

— Нажимаем ОК.

— В Channels выбираем RGB+Alpha.

— Нажимаем ОК.

— В Output To выбираем куда сохранить файл.

— Нажимаем Enter или кнопку «Render».

Есть!

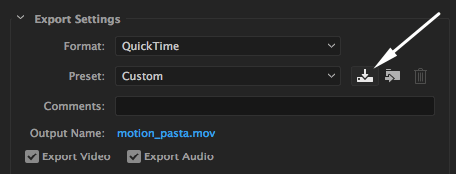

Создаём шаблоны для рендера в Media Encoder

Как в Media Encoder, так и в Render Queue можно создавать шаблоны на все случаи жизни: для H.264, альфа-канала, MP3, PNG-секвенций. Один раз настраиваете рендер, сохраняете в темплейт и в нужный момент переключаетесь между ними.

— Чтобы сохранить шаблон достаточно настроить рендер под себя и нажать на эту кнопку

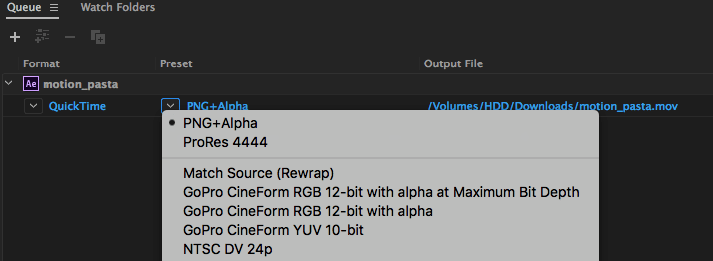

— После этого, созданный темплейт будет доступен в выборе пресетов

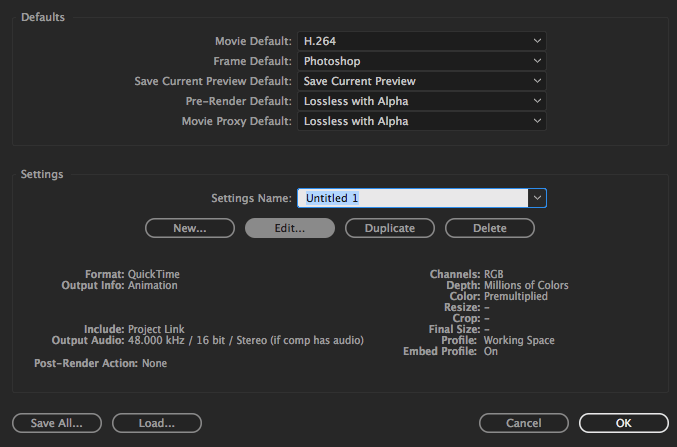

Создаём шаблоны для рендера в Render Queue

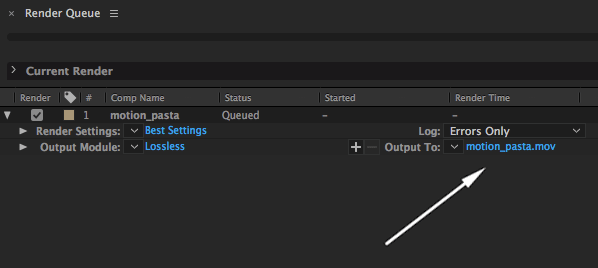

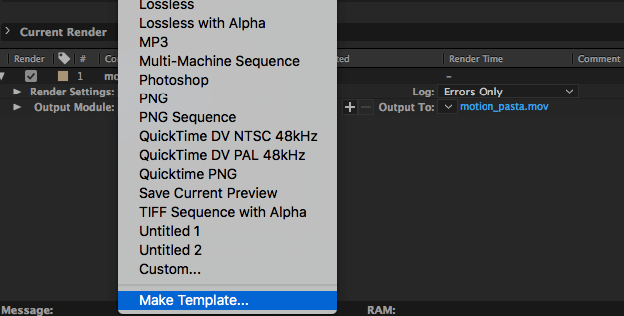

— Настраиваем рендер, нажимаем справа от Output Module на стрелочку и выбираем Make Template

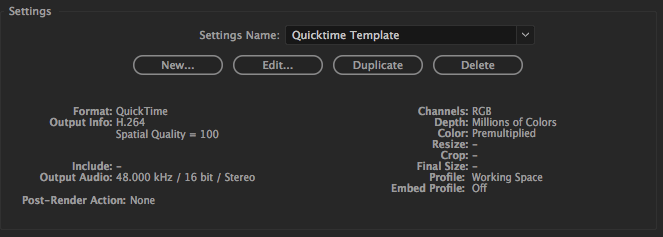

— Задаём имя шаблону — готово, можно рендерить

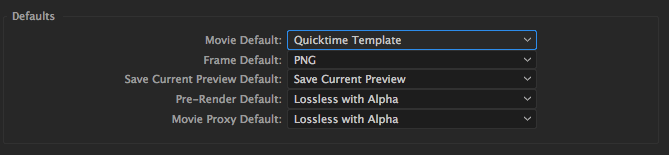

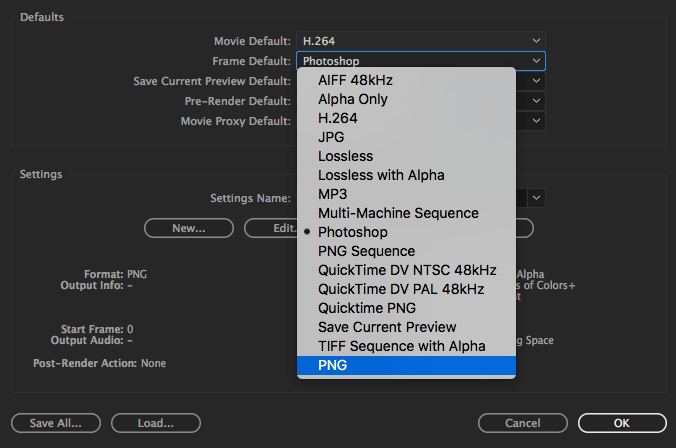

— Чтобы сделать шаблон рендером по умолчанию просто выбираем его в Movie Default

Рендерим один кадр из видео

Сохранить текущий кадр можно двумя способами. Одной кнопкой в плагине FX Console.

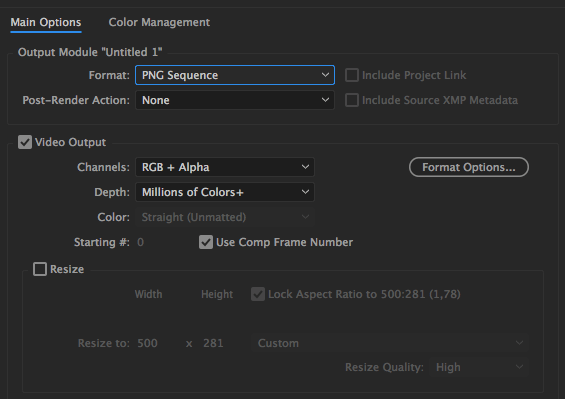

Или штатными средствами After Effects. Единственное, по умолчанию картинка сохраняется в PSD, но это быстро исправить.

— Создаём любую композицию

— Нажимаем Composition → Add To Render Queue

— Справа от Output Module нажимаем на маленькую стрелочку и выбираем Make Template

— В появившемся меню нажимаем Edit

— Format ставим PNG Sequence

— Channels — RGB + Alpha

— Нажимаем ОК

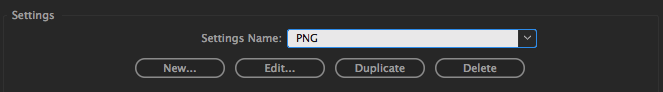

— Переименовываем шаблон

— Ставим его во Frame Default. Нажимаем ОК

— Возвращаемся обратно в нашу композицию

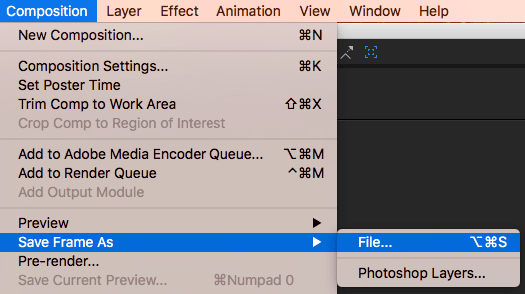

— Выбираем Composition → Save Frame As → File и сохраняем кадр куда нужно. Если будет прозрачность, сохранит с прозрачностью.

Теперь в любом проекте можно нажать Save Frame As или Ctrl+Alt+S и кадр сохранится. Настраивать темплейт снова больше не нужно.

Думаю на этом всё.

Надеюсь, что эта заметка поможет кому-нибудь с рендером. Если что-то непонятно — пишите в комментарии, разберёмся.